Рейтер со ссылкой на источник в Правительстве Японии сообщил, что министры по вопросам цифровых технологий стран-членов G7 (Великобритания, США, Германия, Япония, Франция, Канада и Италия) обсуждают актуальность международных стандартов для использования технологий в контексте того, что во всем мире быстро развиваются инструменты генеративного искусственного интеллекта, такие как, например, ChatGPT компании OpenAI.

Вышеуказанный документ не является обязательным и применяется ко всем заинтересованным сторонам в области технологий искусственного интеллекта. Этот набор правил основан на аналогичном документе, объявленном в октябре этого года, который включает в себя поощрение пользователей улучшать свои собственные цифровые знания о рисках, связанных с ИИ, сотрудничество для оперативного обнаружения уязвимостей и обмена информацией. Документ содержит 12 рекомендаций, направленных на усиление безопасности и защищенности, надежное развитие ИИ во всем мире, включая меры по защите персональных данных и интеллектуальной собственности, а также приоритизации разработки передовых систем ИИ для решения неотложных глобальных проблем, в том числе климатического кризиса.

В частности, разработчикам и компаниям рекомендуется принимать такие меры, как внутреннее тестирование и участие независимых внешних экспертов, чтобы минимизировать риск дезинформации и нарушения конфиденциальности. Кроме того, им рекомендуется разработать инструменты электронных водяных знаков (watermark), которые позволят пользователям идентифицировать контент, созданный ИИ, а также участвовать в обмене информацией и сообщать об инцидентах как в государственном, так и в частном секторах.

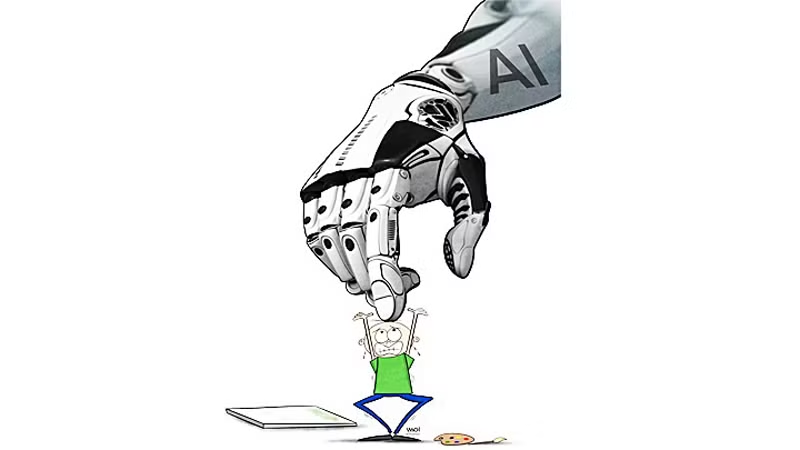

В контексте того, что многие крупные компании в мире активизируют гонку по разработке ИИ, чтобы конкурировать друг с другом, введение G7 набора правил по снижению рисков считается полезным и своевременным инструментом, помогающим определить направления развития ИИ на благо людей.